un camino traslacional basado en la ciencia de implementación sobre aplicación, integración y gobernanza – Gestión y Economía de la Salud

Sandeep Reddy. Implementatio Science 2024

La inteligencia artificial (IA), en particular la IA generativa, se ha convertido en una herramienta transformadora en la atención sanitaria, con el potencial de revolucionar la toma de decisiones clínicas y mejorar los resultados de salud. La IA generativa, capaz de generar nuevos datos, como texto e imágenes, es prometedora para mejorar la atención al paciente, revolucionar el diagnóstico de enfermedades y ampliar las opciones de tratamiento. Sin embargo, la utilidad y el impacto de la IA generativa en la atención sanitaria siguen siendo poco conocidos, lo que genera preocupaciones en torno a las implicaciones éticas y médico-legales, la integración en la prestación de servicios sanitarios y la utilización de la fuerza laboral. Además, no existe un camino claro para implementar e integrar la IA generativa en la prestación de atención médica.

Métodos

Este artículo tiene como objetivo proporcionar una descripción general completa del uso de la IA generativa en la atención médica, centrándose en la utilidad de la tecnología en la atención médica y su aplicación traslacional, destacando la necesidad de una planificación, ejecución y gestión cuidadosas de las expectativas al adoptar la IA generativa en la medicina clínica. Las consideraciones clave incluyen factores como la privacidad de los datos, la seguridad y el papel insustituible de la experiencia de los médicos. Se considera que marcos como el modelo de aceptación de tecnología (TAM) y el modelo de no adopción, abandono, ampliación, difusión y sostenibilidad (NASSS) promueven la integración responsable. Estos marcos permiten anticipar y abordar de manera proactiva las barreras a la adopción, facilitar la participación de las partes interesadas y realizar una transición responsable de los sistemas de atención para aprovechar el potencial de la IA generativa.

Resultados

La IA generativa tiene el potencial de transformar la atención médica a través de sistemas automatizados, una mejor toma de decisiones clínicas y la democratización de la experiencia con herramientas de apoyo al diagnóstico que brindan sugerencias oportunas y personalizadas. Las aplicaciones de IA generativa en facturación, diagnóstico, tratamiento e investigación también pueden hacer que la prestación de atención médica sea más eficiente, equitativa y efectiva. Sin embargo, la integración de la IA generativa requiere una meticulosa gestión del cambio y estrategias de mitigación de riesgos. Las capacidades tecnológicas por sí solas no pueden cambiar ecosistemas de cuidados complejos de la noche a la mañana; más bien, son imperativos programas de adopción estructurados basados en la ciencia de la implementación.

Conclusiones

En este artículo se argumenta firmemente que la IA generativa puede marcar el comienzo de un enorme progreso en la atención sanitaria, si se introduce de forma responsable. La adopción estratégica basada en la ciencia de la implementación, la implementación incremental y mensajes equilibrados sobre oportunidades versus limitaciones ayuda a promover una integración generativa de IA segura y ética. Una amplia experiencia piloto en el mundo real y una iteración alineada con las prioridades clínicas deberían impulsar el desarrollo. Con una gobernanza consciente centrada en el bienestar humano por encima de la novedad tecnológica, la IA generativa puede mejorar la accesibilidad, la asequibilidad y la calidad de la atención. A medida que estos modelos continúan avanzando rápidamente, la reevaluación continua y la comunicación transparente sobre sus fortalezas y debilidades siguen siendo vitales para restaurar la confianza, aprovechar el potencial positivo y, lo más importante, mejorar los resultados de los pacientes.

Fondo

La inteligencia artificial (IA) se ha convertido en una herramienta cada vez más popular en una variedad de campos, incluida la atención médica, con el potencial de transformar la toma de decisiones clínicas y mejorar los resultados de salud [ 1 , 2 , 3 ]. La IA generativa es un área de la IA que ha llamado la atención recientemente por su capacidad de utilizar algoritmos de aprendizaje automático para generar nuevos datos, como texto, imágenes y música [ 4 , 5 , 6 , 7 ]. La IA generativa está demostrando ser un catalizador de cambio en varias industrias, y el sector de la salud no es una excepción [ 8 ]. Con su notable capacidad para analizar extensos conjuntos de datos y generar información valiosa, la IA generativa se ha convertido en una poderosa herramienta para mejorar la atención al paciente [ 9 ], revolucionar el diagnóstico de enfermedades [ 10 ] y ampliar las opciones de tratamiento [ 11 ]. Al aprovechar el potencial de esta tecnología de vanguardia, los profesionales de la salud ahora pueden acceder a niveles sin precedentes de precisión, eficiencia e innovación en sus prácticas.

A pesar de los beneficios potenciales, la utilidad y el impacto de la IA generativa en la atención sanitaria siguen siendo poco conocidos [ 12 , 13 ]. La aplicación de la IA generativa en la atención sanitaria plantea preocupaciones éticas y médico-legales [ 14 ]. Además, no está claro cómo se pueden integrar las aplicaciones de IA generativa en la prestación de servicios sanitarios y cómo el personal sanitario puede utilizarlas de forma adecuada [ 15 ]. Además, no está claro hasta qué punto la IA generativa puede mejorar los resultados de los pacientes y cómo se puede evaluar esto. Por último, es necesario explorar el valor de la IA generativa más allá de aumentar las tareas clínicas y administrativas.

Para aprovechar el enorme potencial de la IA generativa en la atención sanitaria se necesitan enfoques traslacionales basados en la ciencia de la implementación. Estos enfoques reconocen que el progreso tecnológico por sí solo no revolucionará la atención sanitaria de la noche a la mañana [ 16 , 17 ]. El cambio real requiere transiciones sociotécnicas cuidadosamente orquestadas que pongan a las personas en primer lugar. Los enfoques de implementación basados en la ciencia proporcionan hojas de ruta generalizables basadas en evidencia empírica de implementaciones anteriores de TI en salud [ 16 ]. Como tal, los líderes de la atención médica que sean pioneros en la integración de la IA generativa harían bien en aprovechar estos modelos para reforzar la seguridad, la confianza y el impacto del paciente [ 17 ]. Para facilitar la incorporación y aplicación adecuadas de la IA generativa en la atención sanitaria, este artículo tiene como objetivo proporcionar una descripción general del uso de la IA generativa en la atención sanitaria seguida de orientación sobre su aplicación traslacional.

IA generativa

La IA generativa es una clase de tecnología de aprendizaje automático que aprende a generar nuevos datos a partir de datos de entrenamiento [ 18 , 19 ]. Los modelos generativos generan datos similares a los datos originales. Esto puede resultar útil en una variedad de aplicaciones, como la síntesis de imágenes y voz. Otra capacidad única es que pueden usarse para realizar aprendizaje no supervisado, lo que significa que pueden aprender de datos sin etiquetas explícitas [ 8 ]. Esto puede resultar útil en situaciones en las que los datos etiquetados son escasos o costosos de obtener. Además, los modelos generativos de IA pueden generar datos sintéticos aprendiendo las distribuciones de datos subyacentes a partir de datos reales y luego generando nuevos datos que sean estadísticamente similares a los datos reales. Los modelos generativos se diferencian de otros tipos de modelos de aprendizaje automático en que su objetivo es dotar a las máquinas de la capacidad de sintetizar nuevas entidades [ 8 ]. Están diseñados para aprender la estructura subyacente de un conjunto de datos y generar nuevas muestras que sean como los datos originales. Esto contrasta con los modelos discriminativos, que están diseñados para conocer los límites entre diferentes clases de datos. Estos modelos se centran en tareas como clasificación, regresión o aprendizaje por refuerzo, donde el objetivo es hacer predicciones o tomar acciones basadas en datos existentes. Existen varias categorías de IA generativa, como se describe en la Tabla 1 [ 20 , 21 , 22 , 23 ].

Si bien existen varios modelos de IA generativa, este artículo se centrará principalmente en dos modelos, que son populares en el contexto de la atención médica: redes generativas adversarias y modelos de lenguaje grande .

Redes generativas adversarias

Las redes generativas adversarias (GAN) difieren de las técnicas tradicionales de modelado generativo en su enfoque del aprendizaje [ 24 ]. Las GAN utilizan un marco de teoría de juegos con redes en competencia. Las GAN constan de dos redes neuronales, un generador y un discriminador, que compiten entre sí. El generador crea datos falsos para pasarlos al discriminador. Luego, el discriminador decide si los datos que recibió son similares a los datos reales conocidos. Con el tiempo, el generador mejora en la producción de datos que parecen reales, mientras que el discriminador mejora en la diferenciación entre datos reales y falsos. Este proceso de entrenamiento adversario permite a las GAN aprender representaciones de forma no supervisada y semisupervisada. Por el contrario, las técnicas tradicionales de modelado generativo a menudo se basan en modelos probabilísticos explícitos o métodos de inferencia variacional.

Los desarrollos recientes en GAN relacionados con el aprendizaje de representaciones incluyen avances en el aprendizaje de representaciones de espacios latentes [ 24 ]. Estos desarrollos se centran en mejorar la capacidad de las GAN para transformar vectores de ruido generado en muestras sintéticas que se asemejen a los datos del conjunto de entrenamiento. Algunos ejemplos específicos de desarrollos recientes en esta área incluyen GAN aplicadas a la generación de imágenes, aprendizaje semisupervisado, adaptación de dominio, generación controlada por atención y compresión [ 5 ]. Estos avances tienen como objetivo mejorar las capacidades de aprendizaje de representación de las GAN y permitirles generar muestras más realistas y diversas.

Las GAN se han utilizado para generar imágenes realistas [ 24 ]. Estos modelos pueden aprender la distribución subyacente de un conjunto de datos y generar nuevas imágenes que se asemejen a los datos originales. Esto tiene aplicaciones en áreas como gráficos por computadora, arte y entretenimiento. Además, las GAN se pueden utilizar para aumentar los datos de entrenamiento generando muestras sintéticas. Esto puede ayudar en los casos en que el conjunto de datos original es pequeño o está desequilibrado, mejorando el rendimiento de los modelos de aprendizaje automático. Los datos sintéticos, creados mediante algoritmos de aprendizaje automático o redes neuronales, pueden conservar las relaciones estadísticas de los datos reales y al mismo tiempo ofrecer protección de la privacidad. También se están considerando datos sintéticos para mejorar la privacidad.

Grandes modelos de lenguaje

Los modelos de lenguaje grande (LLM) son potentes modelos de IA que se han mostrado prometedores en diversas tareas de procesamiento del lenguaje natural (PLN) [ 25 ]. En particular, la disponibilidad de GPT-4 de OpenAI [ 26 ], Claude de Anthropic [ 27 ] y PaLM2 de Google [ 28 ] ha galvanizado significativamente el progreso no sólo de la PNL sino del campo de la IA en general, donde los comentaristas están discutiendo los logros de la humanidad. Rendimiento de nivel por IA [ 10 , 29 ]. Los LLM como GPT-4 de OpenAI se basan en el modelo autorregresivo. Se utiliza un modelo autorregresivo para generar secuencias, como oraciones en lenguaje natural, mediante la predicción de un elemento siguiente basado en los anteriores [ 30 ]. La diferencia entre los LLM y los modelos de lenguaje tradicionales radica en sus capacidades y métodos de formación [ 25 ]. Los LLM, como GPT-4, utilizan la arquitectura Transformers, que ha demostrado ser eficaz para comprender el contexto de las palabras en una oración. Un transformador utiliza un mecanismo llamado «atención» para sopesar la importancia de las palabras al hacer predicciones [ 31 ]. Este mecanismo permite que el modelo considere la historia completa de una oración, lo que lo convierte en una herramienta poderosa para tareas de predicción de secuencias. Los LLM están capacitados en un gran corpus de datos de texto. Durante el entrenamiento, el modelo aprende a predecir la siguiente palabra en una oración dadas las palabras anteriores. Lo hace ajustando sus parámetros internos para minimizar la diferencia entre sus predicciones y las palabras reales que siguen en los datos de entrenamiento.

Una de las ventajas clave de los LLM es su capacidad para realizar muchas tareas de procesamiento del lenguaje sin la necesidad de datos de capacitación adicionales [ 32 ]. Esto se debe a que ya han sido entrenados en un vasto corpus de texto, lo que les permite generar respuestas coherentes y contextualmente relevantes basadas en los aportes que reciben. Esto los hace particularmente útiles como referencias u oráculos para modelos de resumen de texto. El resumen de texto es una tarea compleja que implica comprender los puntos principales de un fragmento de texto y luego condensarlos en una forma más breve. Los LLM se pueden utilizar para generar resúmenes de texto, que luego se pueden utilizar como referencia o «estándar de oro» para otros modelos de resumen [ 25 ]. Esto puede ayudar a mejorar el rendimiento de estos modelos proporcionándoles resúmenes de alta calidad de los que aprender.

Además de los resúmenes de texto, los LLM también se han utilizado en una variedad de otras aplicaciones [ 15 ]. En el ámbito de la clasificación de texto, los LLM se pueden utilizar para categorizar automáticamente fragmentos de texto en categorías predefinidas. Esto puede resultar útil en una variedad de aplicaciones, desde la detección de spam en filtros de correo electrónico hasta el análisis de opiniones en las reseñas de los clientes. Finalmente, se han utilizado los LLM para la evaluación automática de la atribución. Esto implica determinar la fuente o el autor de un texto. Por ejemplo, un LLM podría usarse para determinar si un tweet en particular fue escrito por una persona específica o para identificar al autor de un escrito anónimo.

Es importante tener en cuenta que, si bien los LLM son poderosos, tienen limitaciones [ 15 ]. Debido a que generan secuencias un componente a la vez, son inherentemente secuenciales y no pueden paralelizarse. Además, son causales, lo que significa que sólo pueden utilizar información del pasado, no del futuro, al hacer predicciones [ 33 , 34 ]. Pueden tener dificultades para capturar dependencias de largo alcance debido al problema del gradiente que desaparece, aunque arquitecturas como Transformers ayudan a mitigar este problema.

Aplicación de la IA generativa en la atención sanitaria

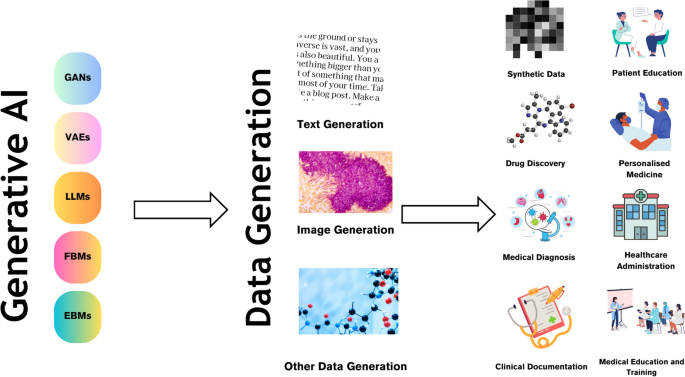

Los modelos generativos de IA que facilitan la creación de texto e imágenes se consideran una herramienta prometedora en el contexto de la atención sanitaria [ 26 , 35 , 36 ]. La IA generativa puede transformar la atención médica al permitir mejoras en el diagnóstico, reducir el costo y el tiempo necesarios para brindar atención médica y mejorar los resultados de los pacientes (Fig. 1 ).

Casos de uso de IA generativa en la atención sanitaria. Los modelos de IA generativa, como las redes generativas adversarias (GAN) y los modelos de lenguaje grande (LLM), se utilizan para generar diversas modalidades de datos, incluidos datos de texto e imágenes, que luego se utilizan para diversos escenarios, incluido el descubrimiento de fármacos, el diagnóstico médico, la documentación clínica y la educación del paciente. Medicina personalizada, administración sanitaria y educación médica, entre otros casos de uso.

Generación y aumento de datos sintéticos.

Los datos sintéticos, que se crean utilizando modelos generativos de IA como las GAN, son una solución cada vez más prometedora para equilibrar el acceso a datos valiosos y la protección de la privacidad del paciente [ 9 ]. Mediante el uso de modelos de IA generativa, se pueden crear datos de pacientes realistas y anonimizados con fines de investigación y capacitación, al tiempo que se permite una amplia gama de aplicaciones versátiles. Además, las GAN pueden sintetizar datos de registros médicos electrónicos (EHR) aprendiendo las distribuciones de datos subyacentes, lo que permite un rendimiento excelente y aborda desafíos como las preocupaciones sobre la privacidad de los datos. Este enfoque puede ser particularmente útil en situaciones donde hay una cantidad limitada de datos de pacientes del mundo real disponibles, o cuando el acceso a dichos datos está restringido debido a preocupaciones de privacidad. Además, el uso de datos sintéticos puede ayudar a mejorar la precisión y solidez de los modelos de aprendizaje automático, ya que permite utilizar una gama de datos más diversa y representativa en el proceso de capacitación. Además, la capacidad de generar datos sintéticos con diferentes características y parámetros puede permitir a los investigadores y médicos investigar y probar diversas hipótesis [ 5 , 9 , 37 ], lo que conducirá a nuevos conocimientos y descubrimientos.

Descubrimiento de medicamento

Los modelos generativos de IA también se están utilizando para generar nuevas moléculas pequeñas, secuencias de ácidos nucleicos y proteínas con una estructura o función deseada, lo que ayuda en el descubrimiento de fármacos [ 11 ]. Al analizar la estructura química de fármacos exitosos y simular variaciones, la IA generativa puede producir candidatos a fármacos potenciales a un ritmo mucho más rápido que los métodos tradicionales de descubrimiento de fármacos. Esto no sólo ahorra tiempo y recursos, sino que también puede ayudar a identificar medicamentos que pueden haber pasado desapercibidos con los métodos tradicionales. Además, el uso de IA generativa también puede ayudar a predecir la eficacia y seguridad de nuevos medicamentos, lo cual es un paso crucial en el proceso de desarrollo de fármacos. Al analizar grandes cantidades de datos, la IA generativa puede ayudar a identificar posibles problemas que puedan surgir durante los ensayos clínicos, lo que en última instancia puede reducir el tiempo y el costo del desarrollo de fármacos [ 11 , 38 ]. Además, la IA generativa, al identificar procesos biológicos específicos que desempeñan un papel en la enfermedad, puede ayudar a identificar nuevos objetivos para el desarrollo de fármacos, lo que en última instancia puede conducir al desarrollo de tratamientos más eficaces.

Diagnostico medico

Los modelos generativos se pueden entrenar en vastos conjuntos de datos de registros médicos e imágenes (como resonancias magnéticas y tomografías computarizadas) para identificar patrones relacionados con enfermedades. Por ejemplo, las GAN se han utilizado para la reconstrucción, síntesis, segmentación, registro y clasificación de imágenes [ 5 , 9 , 37 , 39 ]. Además, las GAN se pueden utilizar para generar imágenes médicas sintéticas que se pueden utilizar para entrenar modelos de aprendizaje automático para diagnósticos basados en imágenes o aumentar conjuntos de datos médicos. Los LLM pueden mejorar la salida de múltiples redes CAD, como redes de diagnóstico, redes de segmentación de lesiones y redes de generación de informes, al resumir y reorganizar la información presentada en formato de texto en lenguaje natural. Esto puede crear un sistema más fácil de usar y comprensible para los pacientes en comparación con los sistemas CAD convencionales.

Los EHR y otros registros de pacientes son ricos depósitos de datos, y los LLM se pueden utilizar para analizar estos registros de una manera sofisticada [ 40 ]. Pueden procesar y comprender la información y la terminología utilizada en estos registros, lo que les permite extraer e interpretar información médica compleja. Esta capacidad se extiende más allá de la simple coincidencia de palabras clave, ya que los LLM pueden inferir el significado a partir de información incompleta e incluso recurrir a un vasto corpus médico para dar sentido a los datos. Además, los LLM pueden integrar y analizar información de múltiples fuentes dentro del EHR. Pueden correlacionar datos de resultados de laboratorio, notas del médico e informes de imágenes médicas para generar una visión más holística de la salud del paciente [ 10 ]. Esto puede resultar particularmente útil en casos complejos donde el paciente tiene múltiples afecciones o síntomas que pueden estar relacionados.

Los LLM, como GPT-4, han demostrado conocimientos médicos a pesar de carecer de formación específica en medicina [ 10 , 29 ]. Uno de los aspectos más impresionantes de estos modelos es su capacidad para aplicar este conocimiento en tareas de toma de decisiones [ 10 ]. Por ejemplo, cuando se le presenta un escenario de paciente hipotético, un LLM puede generar una lista de diagnósticos potenciales basados en los síntomas descritos, sugerir pruebas apropiadas para confirmar el diagnóstico e incluso proponer un plan de tratamiento. En algunos estudios, estos modelos han mostrado un rendimiento casi aprobado en exámenes médicos, demostrando un nivel de comprensión comparable al de un estudiante de medicina [ 29 ]. Sin embargo, existen límites y los resultados de los modelos pueden conllevar ciertos riesgos y no pueden sustituir completamente el juicio clínico y la capacidad de toma de decisiones de los médicos ambulatorios [ 14 ].

Documentación clínica y administración sanitaria.

Los LLM como GPT-4 y PALM-2 se pueden utilizar para generar resúmenes de datos de pacientes [ 41 ]. Esto podría resultar especialmente útil en entornos sanitarios donde se recopilan grandes cantidades de datos y es necesario interpretarlos de forma rápida y precisa. Por ejemplo, una HCE puede contener datos del paciente, como historial médico, medicamentos, alergias y resultados de laboratorio. Se podría entrenar un modelo de IA generativa para leer estos datos, comprender los puntos clave y generar un resumen conciso. Este resumen podría resaltar información crítica como diagnóstico, medicamentos recetados y tratamientos recomendados. También podría identificar tendencias en la salud del paciente a lo largo del tiempo. Al automatizar este proceso, los proveedores de atención médica podrían ahorrar tiempo y garantizar que no se pase por alto nada importante. Además, estos resúmenes podrían usarse para mejorar la comunicación entre diferentes proveedores de atención médica y entre proveedores y pacientes, ya que brindan una descripción general clara y concisa del estado de salud del paciente. La capacidad de los LLM para automatizar dichos procesos puede aliviar la carga de documentación actual y el consiguiente agotamiento que enfrentan muchos médicos en todo el mundo [ 41 ]. Actualmente, muchos médicos, debido a políticas organizacionales o requisitos de seguro médico, deben completar una documentación extensa que va más allá de lo que se requiere para la atención clínica de rutina. Los estudios han demostrado que muchos médicos dedican más de 1 hora a tareas de registros médicos electrónicos por cada hora de tiempo clínico directo presencial [ 42 ]. Además, la carga cognitiva y la frustración asociadas con la documentación pueden reducir la satisfacción laboral. contribuyendo a su agotamiento [ 43 ]. La implementación de herramientas de procesamiento del lenguaje natural para automatizar la documentación podría reducir esta carga. Un LLM integrado en la plataforma de información relevante puede realizar la documentación y proporcionar versiones preliminares para que el médico las apruebe [ 40 , 41 ]. Por ejemplo, los hospitales pueden utilizar LLM para generar notas de progreso de rutina y resúmenes de alta [ 44 ].

Además de esto, existe la posibilidad de que estas aplicaciones basadas en LLM reduzcan los errores médicos y capturen información perdida al proporcionar una capa de escrutinio cuando se integran en los EHR [ 45 ]. Además de automatizar la documentación, los LLM integrados en los EHR podrían ayudar a reducir los errores médicos y garantizar que no se pierda información importante. Los estudios han encontrado que muchos pacientes hospitalarios experimentarán un error médico prevenible, a menudo debido a problemas como diagnósticos erróneos, errores de prescripción o hallazgos de exámenes que no se siguen correctamente [ 46 ]. Además, los LLM tienen el potencial de servir como una herramienta de apoyo a la toma de decisiones al analizar los historiales de los pacientes y señalar discrepancias o brechas en la atención [ 45 ]. Por ejemplo, un LLM podría comparar los síntomas y diagnósticos actuales con el historial médico pasado para informar a los médicos sobre las condiciones que requieren más investigación. Además, podrían escanear las listas de medicamentos y advertir sobre posibles interacciones adversas o contraindicaciones.

La IA generativa también se puede utilizar para automatizar tareas rutinarias en el sector sanitario, como programar citas, procesar reclamaciones y gestionar registros de pacientes [ 47 ]. Por ejemplo, los modelos de IA se pueden utilizar para desarrollar sistemas de programación inteligentes. Estos sistemas pueden interactuar con los pacientes a través de chatbots o asistentes de voz para programar, reprogramar o cancelar citas. Pueden considerar factores como la disponibilidad del médico, el horario preferido del paciente y la urgencia de la cita para optimizar el proceso de programación. La IA generativa también puede automatizar el proceso de reclamaciones de seguros. Puede leer y comprender los documentos del reclamo, verificar la información, verificar si hay discrepancias y procesar el reclamo. Esto puede reducir significativamente el tiempo necesario para procesar las reclamaciones y minimizar los errores. Al automatizar estas tareas, los proveedores de atención médica pueden ahorrar tiempo y recursos y mejorar la experiencia del paciente al obtener respuestas más rápidas y un servicio más eficiente.

Medicina personalizada

La IA generativa puede analizar la composición genética, el estilo de vida y el historial médico de un paciente para predecir cómo podrían responder a diferentes tratamientos [ 48 ]. Esto se logra entrenando a la IA con grandes conjuntos de datos de información del paciente, lo que le permite identificar patrones y correlaciones que podrían no ser inmediatamente evidentes para los médicos humanos. Por ejemplo, la IA podría notar que los pacientes con un determinado marcador genético responden particularmente bien a un medicamento específico. Esta información luego se puede utilizar para crear un plan de tratamiento personalizado que se adapte a las necesidades individuales de cada paciente. Este enfoque puede conducir a un tratamiento más eficaz, ya que considera los factores únicos que podrían afectar la respuesta del paciente a la medicación. También puede conducir a mejores resultados para los pacientes, ya que los tratamientos pueden optimizarse en función de las predicciones de la IA [ 48 ].

La IA generativa también se puede utilizar en el campo de la salud mental, particularmente en la creación de herramientas interactivas para la terapia cognitivo-conductual (TCC) [ 49 , 50 ]. La TCC es un tipo de psicoterapia que ayuda a los pacientes a controlar sus afecciones cambiando su forma de pensar y comportarse. La IA generativa se puede utilizar para crear escenarios y respuestas personalizados que se adapten a las necesidades individuales del paciente. Por ejemplo, la IA podría generar un escenario que desencadene la ansiedad de un paciente y luego guiarlo a través de una serie de respuestas para ayudarlo a controlar su reacción. Esto puede proporcionar a los pacientes un entorno seguro y controlado en el que practicar sus estrategias de afrontamiento, lo que podría conducir a mejores resultados de salud mental.

Educación y formación médica.

En el contexto de la educación y formación médica, esta tecnología se puede utilizar para generar una amplia variedad de casos de pacientes virtuales. Estos casos pueden basarse en una amplia gama de condiciones médicas, datos demográficos de los pacientes y escenarios clínicos, proporcionando una plataforma de aprendizaje integral para estudiantes de medicina y profesionales de la salud [ 51 , 52 ]. Uno de los principales beneficios del uso de la IA generativa en la educación médica es la capacidad de crear un entorno de aprendizaje seguro y controlado. Los estudiantes de medicina pueden interactuar con estos pacientes virtuales, realizar diagnósticos y proponer planes de tratamiento sin ningún riesgo para los pacientes reales. Esto permite a los estudiantes cometer errores y aprender de ellos en un entorno de bajo riesgo. La IA generativa también puede crear casos de pacientes que son raros o complejos, brindando a los estudiantes la oportunidad de adquirir experiencia y conocimiento en áreas que quizás no encuentren con frecuencia en su práctica clínica. Esto puede resultar particularmente beneficioso para preparar a los estudiantes para situaciones inesperadas y mejorar sus habilidades para resolver problemas. Además, el uso de la IA en la educación médica puede proporcionar una experiencia de aprendizaje más personalizada. La IA puede adaptarse al ritmo y estilo de aprendizaje de cada individuo, presentando casos que sean más relevantes para sus necesidades de aprendizaje. Por ejemplo, si un estudiante tiene problemas con una condición médica particular, la IA puede generar más casos relacionados con esa condición para practicar más.

Además de crear casos de pacientes virtuales, la IA generativa también se puede utilizar para simular conversaciones entre profesionales de la salud y pacientes [ 51 , 52 ]. Esto puede ayudar a los estudiantes a mejorar sus habilidades de comunicación y aprender a transmitir noticias difíciles de manera sensible y empática. Además, la integración de la IA en la educación médica puede proporcionar datos valiosos para los educadores. La IA puede rastrear el desempeño de los estudiantes, identificar áreas de mejora y brindar retroalimentación, ayudando a los educadores a perfeccionar sus estrategias de enseñanza y planes de estudio.

Educación del paciente

La IA generativa se puede utilizar para la educación del paciente de varias maneras [ 35 , 41 ]. Se puede utilizar para crear contenido educativo personalizado basado en la condición, los síntomas o las preguntas específicas de un paciente. Por ejemplo, si un paciente tiene diabetes, la IA puede generar información sobre el control de los niveles de azúcar en sangre, la dieta, el ejercicio y la medicación. La IA generativa también puede involucrar a los pacientes en experiencias de aprendizaje interactivas. Los pacientes pueden hacer preguntas y la IA puede generar respuestas, creando un diálogo que ayuda al paciente a comprender mejor su condición. Esto puede resultar particularmente útil para los pacientes que pueden sentirse tímidos o avergonzados al hacer ciertas preguntas a sus proveedores de atención médica. Además, la IA generativa también puede crear ayudas visuales, como diagramas o infografías, para ayudar a los pacientes a comprender conceptos médicos complejos. Por ejemplo, podría generar un diagrama que muestre cómo funciona un fármaco en particular en el cuerpo.

La IA generativa se puede programar para generar contenido en diferentes niveles de lectura, lo que ayuda a mejorar la alfabetización sanitaria entre pacientes con diferentes niveles de educación y comprensión [ 53 ]. También se puede utilizar para crear contenido educativo de seguimiento y recordatorios para los pacientes. Por ejemplo, podría generar una serie de correos electrónicos o mensajes de texto recordando al paciente que debe tomar su medicación, junto con información sobre por qué es importante. Además, la IA generativa se puede utilizar para brindar apoyo a la salud mental, generando respuestas a las preocupaciones o ansiedades de los pacientes sobre sus condiciones de salud. Esto puede ayudar a los pacientes a sentirse más apoyados y menos solos en su camino hacia la salud. Por último, la IA generativa puede generar contenido educativo en varios idiomas, haciendo que la información sanitaria sea más accesible para los pacientes que no hablan inglés como primer idioma.

Camino traslacional

El camino traslacional de la IA generativa en la atención sanitaria es un viaje que implica la integración de esta tecnología avanzada en el entorno clínico [ 54 ]. Este proceso tiene el potencial de revolucionar la forma en que se brinda la atención médica, al automatizar tareas y generar información relevante, mejorando así la eficiencia de la prestación de atención médica [ 26 , 35 ]. La IA generativa puede automatizar tareas rutinarias como la entrada de datos, la programación de citas e incluso algunos aspectos de la atención al paciente como el seguimiento de los signos vitales o la administración de medicamentos. Esta automatización puede liberar una cantidad significativa de tiempo a los médicos, permitiéndoles centrarse más en la atención directa al paciente. Al reducir la carga administrativa de los proveedores de atención médica, la IA generativa puede ayudar a mejorar la calidad de la atención y aumentar la satisfacción del paciente [ 41 , 53 ]. Además de automatizar tareas, la IA generativa también puede generar información relevante para los médicos. Por ejemplo, puede analizar datos de pacientes para predecir resultados de salud, identificar riesgos potenciales para la salud y sugerir planes de tratamiento personalizados. Esta capacidad de generar conocimientos a partir de datos puede ayudar a los médicos a tomar decisiones más informadas sobre la atención al paciente, lo que podría conducir a mejores resultados para los pacientes.

Sin embargo, la precisión y la integridad de la información generada por la IA son cruciales. La información inexacta o incompleta puede provocar un diagnóstico erróneo o un tratamiento inadecuado, lo que puede perjudicar a los pacientes [ 14 , 55 ]. Por lo tanto, es esencial garantizar que los sistemas de IA estén bien diseñados y probados exhaustivamente para producir resultados confiables. A pesar de los posibles beneficios, adoptar la IA generativa en la medicina clínica no es un proceso sencillo. Requiere una planificación y ejecución cuidadosas [ 56 ]. Esto incluye comprender las necesidades de los proveedores de atención médica y de los pacientes, seleccionar la tecnología de inteligencia artificial adecuada, integrarla en los sistemas de atención médica existentes y capacitar al personal para usarla de manera efectiva. Además, también es necesario abordar consideraciones legales y éticas, como la privacidad y la seguridad de los datos. Además, es importante gestionar las expectativas sobre lo que la IA generativa puede y no puede hacer. La experiencia de los médicos y su capacidad para empatizar con los pacientes siguen siendo cruciales para brindar atención de alta calidad.

La traducción exitosa de la IA generativa a la práctica clínica depende de estrategias de adopción bien pensadas y basadas en la ciencia de la implementación. Dos modelos ofrecen andamios sólidos: el modelo de aceptación de tecnología (TAM) a nivel de usuario individual [ 57 ] y el marco de no adopción, abandono, ampliación, difusión y sostenibilidad (NASSS) para la integración organizacional [ 58 ]. Basado en la teoría sociopsicológica, TAM proporciona un modelo basado en evidencia sobre cómo las percepciones del usuario final dan forma a la aceptación de nuevas tecnologías como la IA generativa [ 59 ]. Sus principios básicos postulan que la utilidad percibida y la facilidad de uso percibida resultan ser los más determinantes de la adopción. TAM ofrece un enfoque cuantificable para predecir e influir en la adopción que los esfuerzos de implementación deben considerar. La segmentación del personal y la evaluación de creencias permiten intervenciones personalizadas que abordan barreras como la falta de habilidades, el compromiso, la integración del flujo de trabajo y los beneficios demostrables. Igualmente crucial es que el marco NASSS ofrece una metodología holística que evalúa variables multinivel implicadas en la incorporación exitosa de innovaciones. Sus siete dominios críticos abarcan el diseño de tecnología, propuestas de valor, prioridades de los adoptantes, dinámica organizacional, factores contextuales más amplios y su compleja interacción [ 58 ]. Juntas, estas lentes refuerzan la IA generativa introducida de manera responsable, monitorean el progreso y recalibran en función de la retroalimentación emergente. La fusión de las perspectivas de TAM y NASSS proporciona un poderoso plan para introducir cuidadosamente la IA generativa en la atención médica del siglo XXI. Aportan estrategias implementables para la transición sociotécnica que tales innovaciones necesitan, promoviendo la aceptación, facilitando la integración, entregando valor sostenido y, en última instancia, transformando la atención.

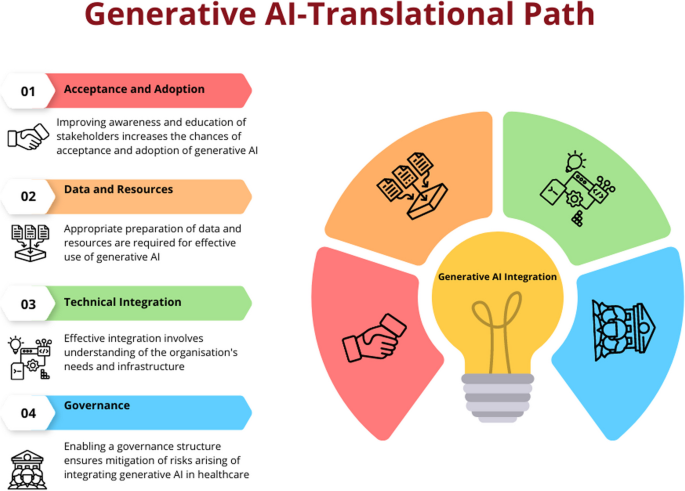

Con base en estos marcos, el contenido a continuación analiza los componentes o pasos clave que una organización o servicio de atención médica debe considerar al integrar la IA generativa en la prestación de sus servicios. La descripción permitirá a los socios saber cómo preparar sus organizaciones y su fuerza laboral para adoptar e integrar la IA generativa para permitir una prestación de atención óptima. Sin embargo, la descripción no cubre aspectos políticos y legislativos más amplios que se requieren para facilitar la introducción de la IA generativa en la atención sanitaria. Estas características son exclusivas de varias jurisdicciones y continúan evolucionando rápidamente, por lo que se consideran fuera del alcance de este artículo.

Primer componente: aceptación y adopción.

La implementación exitosa de la IA en la atención médica depende de la comprensión y aceptación de sus aplicaciones por parte de los usuarios finales [ 54 ], incluidos los profesionales médicos y los pacientes. Esta comprensión fomenta la confianza en los sistemas de IA, permite su uso eficaz y ayuda a afrontar los desafíos éticos y regulatorios. Además, un conocimiento sólido de la IA promueve el aprendizaje continuo y la adaptación al panorama cambiante de la tecnología de IA. Por lo tanto, invertir en mejorar la concientización de todos los socios es crucial para garantizar la adopción y utilización efectiva de la IA en la atención médica.

La utilización de los marcos TAM y NASSS para la implementación de IA generativa en la atención médica implica la consideración de los siguientes componentes:

- ▪ Utilidad percibida : se refiere al grado en que una persona cree que el uso de un sistema particular mejoraría su desempeño laboral. En el contexto de la IA generativa en la atención sanitaria, esta podría ser la forma en que la IA podría ayudar a diagnosticar enfermedades, predecir los resultados de los pacientes, personalizar los planes de tratamiento y mejorar la eficiencia administrativa. Por ejemplo, la IA podría generar modelos predictivos de los resultados de los pacientes en función de su historial médico, su estado de salud actual y una amplia base de datos de casos similares.

- ▪ Facilidad de uso percibida : se refiere al grado en que una persona cree que usar un sistema en particular estaría libre de esfuerzo. Para la IA generativa en la atención sanitaria, esto podría significar lo fácil que es para los profesionales sanitarios comprender y utilizar el sistema de IA. Esto incluye la interfaz de usuario, la claridad de los resultados de la IA y el nivel de soporte técnico disponible.

- ▪ Actitud hacia el uso : la propuesta de valor de la IA generativa en la atención médica es convincente y ofrece beneficios como rentabilidad, velocidad y opciones de tratamiento personalizadas [ 5 ]. Si los profesionales sanitarios perciben el sistema de IA como útil y fácil de usar, es probable que desarrollen una actitud positiva hacia su uso. Esta actitud positiva podría mejorarse aún más proporcionando formación y apoyo adecuados y demostrando el uso exitoso de la IA en entornos sanitarios similares.

- ▪ Intención conductual de uso : una vez que los profesionales de la salud tienen una actitud positiva hacia el sistema de IA, es más probable que tengan la intención de utilizarlo. Esta intención podría convertirse en un uso real brindando oportunidades para utilizar el sistema de IA en un entorno seguro y de apoyo e integrando el sistema de IA en los flujos de trabajo existentes.

- ▪ Uso real del sistema : el paso final es el uso real del sistema de IA en la práctica sanitaria diaria. Esto podría fomentarse brindando soporte continuo y monitoreando y mejorando continuamente el sistema de inteligencia artificial en función de los comentarios de los usuarios y los datos de rendimiento.

Además de estos factores, el modelo también sugiere que factores externos como la influencia social y las condiciones facilitadoras pueden influir en la aceptación y el uso de una nueva tecnología [ 57 , 59 ]. En el caso de la IA generativa en la atención sanitaria, estas podrían incluir la aprobación regulatoria, consideraciones éticas, la aceptación del paciente y la política sanitaria general y el entorno económico.

Segundo componente: datos y recursos

La adopción de IA generativa implica preparar datos y recursos dentro de una organización para utilizar esta tecnología de forma eficaz. Se trata de un proceso complejo que requiere un enfoque sistemático y estratégico que implica varios pasos clave.

- ▪ Identificación de casos de uso : las organizaciones de atención médica deben comenzar por identificar los casos de uso específicos donde la IA generativa puede aportar valor. La IA generativa tiene como objetivo abordar diversas afecciones médicas, desde enfermedades crónicas como la diabetes hasta afecciones agudas como el accidente cerebrovascular [ 6 , 38 , 60 ]. La complejidad de la condición médica a menudo dicta el nivel de sofisticación requerido del modelo de IA. Por ejemplo, el uso de la IA para el diagnóstico por imágenes del cáncer es complejo y requiere una gran precisión. Comprender los casos de uso específicos ayudará a guiar el proceso de preparación de datos.

- ▪ Recopilación de datos : los modelos de IA generativa aprenden de los datos [ 8 ], por lo que la organización sanitaria debe recopilar y preparar datos relevantes para entrenar los modelos. Esto podría implicar la recopilación de datos primarios existentes de varias fuentes dentro de la organización o la recopilación de nuevos datos si es necesario. Luego, los datos deben limpiarse y preprocesarse, lo que puede implicar tareas como eliminar duplicados, manejar valores faltantes y normalizar datos.

- ▪ Limpieza y preprocesamiento de datos : es necesario limpiar y preprocesar los datos recopilados para garantizar su calidad y coherencia [ 61 , 62 ]. Esto puede implicar eliminar duplicados, manejar valores faltantes, estandarizar formatos y abordar cualquier otro problema de calidad de los datos. Los pasos de preprocesamiento también pueden incluir técnicas de normalización de datos, escalado de características y aumento de datos para mejorar el proceso de capacitación. Es importante resaltar la necesidad de uniformidad en la calidad de los conjuntos de datos para permitir una integración perfecta de datos multifuncionales. Además, la calidad de los datos es crucial ya que los algoritmos generativos de IA aprenden de los datos. La calidad de los datos puede verse afectada por diversos factores, como ruido, valores faltantes, valores atípicos, datos sesgados, falta de equilibrio en la distribución, inconsistencia, redundancia, heterogeneidad, duplicación e integración de datos.

- ▪ Anotación y etiquetado de datos : según el caso de uso, es posible que la organización necesite anotar y etiquetar los datos para proporcionar información real y estándar clínica para entrenar los modelos de IA generativa, específicamente para ajustar los LLM con datos locales [ 10 ]. Esto podría implicar tareas como segmentación de imágenes, detección de objetos, análisis de sentimientos o categorización de texto. Las anotaciones precisas y completas son esenciales para entrenar modelos de manera efectiva.

- ▪ Almacenamiento y gestión de datos : será un requisito establecer o utilizar un sistema sólido de almacenamiento y gestión de datos para manejar los grandes volúmenes de datos necesarios para la IA generativa. Esto puede implicar la creación de un almacén de datos, almacenamiento en la nube o el uso de plataformas de gestión de datos. Al mismo tiempo, se garantiza que los datos estén organizados, sean accesibles y seguros para una capacitación y una implementación de modelos eficientes. La federación de datos es una tecnología que se puede considerar aquí, ya que permite la creación de una base de datos físicamente descentralizada pero funcionalmente unificada. Esta tecnología es particularmente útil en la atención médica, ya que permite que varias fuentes de datos mantengan los datos dentro de sus firewalls. Sin embargo, es posible que este paso no sea necesario en la mayoría de los casos de uso de LLM, especialmente si se utilizan a través de llamadas a la interfaz de programación de aplicaciones (API) o servicios en la nube.

- ▪ Recursos computacionales : los modelos de IA generativa a menudo requieren una potencia computacional y recursos importantes para el entrenamiento y la inferencia, como GPU o servicios de computación en la nube [ 8 , 15 ]. El desarrollo interno y la formación de LLM requieren importantes recursos computacionales, que las organizaciones deben considerar cuidadosamente [ 63 ]. Los LLM comerciales ofrecidos a través de servicios en la nube o API ahorran a las organizaciones esta carga de infraestructura. Sin embargo, para aquellos que intentan entrenar modelos propietarios adaptados a sus datos y casos de uso específicos, es fundamental asegurar una capacidad informática suficiente.

Los factores que afectan los requisitos computacionales incluyen el tamaño del modelo, el volumen de datos de entrenamiento y la velocidad de iteración deseada. Por ejemplo, una empresa que pretenda entrenar un modelo con más de mil millones de parámetros en decenas de miles de millones de ejemplos de texto probablemente buscaría un clúster informático de alto rendimiento o aprovecharía plataformas de aprendizaje automático basadas en la nube. La configuración precisa del hardware, incluidas GPU/TPU, CPU, memoria, almacenamiento y redes, se adapta a la arquitectura del modelo y al plan de capacitación [ 63 ].

El desarrollo y ajuste continuo del modelo también requiere computación disponible. Las organizaciones pueden elegir entre continuar asignando recursos internos o ciclos de subcontratación a través de servicios en la nube [ 63 ]. La planificación presupuestaria debe tener en cuenta estas demandas informáticas recurrentes si una prioridad es mejorar continuamente los LLM internos. En general, si bien aprovechar los LLM externos puede minimizar las inversiones en infraestructura, las iniciativas internas serias de LLM pueden rivalizar con la escala computacional de los laboratorios de investigación industrial.

Tercer componente: integración técnica

La integración de la IA generativa en un sistema o plataforma de información sanitaria puede aportar numerosos beneficios, como un mejor diagnóstico de enfermedades, una mejor monitorización de los pacientes y una prestación de atención sanitaria más eficiente. Sin embargo, las tecnologías de IA generativa como GAN y LLM son complejas de comprender e implementar [ 8 ]. La madurez, la confiabilidad y la facilidad de integración de la tecnología en los sistemas existentes son factores cruciales que afectan su adopción [ 58 ]. Por lo tanto, integrar la IA generativa en un sistema de información hospitalaria o sanitaria implica varios pasos que van desde comprender las necesidades del sistema hasta implementar y mantener la solución de IA. El primer paso para integrar la IA generativa en un sistema de salud es identificar el área de enfoque de implementación [ 62 ]. Esto podría ser cualquier cosa, desde mejorar la atención al paciente, simplificar las tareas administrativas, mejorar la precisión del diagnóstico o predecir los resultados de los pacientes. Una vez identificada la necesidad, es necesario elegir el modelo de IA adecuado. Los modelos de IA generativa, como las GAN, se pueden utilizar para tareas como sintetizar imágenes médicas o generar datos de pacientes [6, 37). Los LLM se pueden utilizar para el análisis de HCE y como herramienta de apoyo a la toma de decisiones clínicas [ 40 ]. Una vez elegido el modelo, es necesario entrenarlo con los datos recopilados. Esto implica introducir los datos en el modelo y ajustar los parámetros del modelo hasta que pueda predecir con precisión los resultados o generar resultados útiles.

Una vez que el modelo de IA se entrena y prueba, se puede integrar en el sistema de información sanitaria [ 56 , 62 ]. Esto implica desarrollar una interfaz entre el modelo de IA y el sistema existente, asegurando que el modelo pueda acceder a los datos que necesita y que el sistema pueda utilizar sus resultados. El desarrollo de una interfaz o API de este tipo permite que los modelos de IA generativa se integren perfectamente en el flujo de trabajo clínico o organizacional. Después de la integración, el sistema de IA debe probarse exhaustivamente para garantizar su funcionalidad, usabilidad y confiabilidad.

También es necesario un mantenimiento regular para actualizar el modelo a medida que haya nuevos datos disponibles y volver a entrenarlo si su rendimiento disminuye [ 56 , 62 ]. Además, recopilar comentarios periódicos o programados de los profesionales de la salud garantizará que la organización pueda realizar las mejoras necesarias para mejorar el rendimiento del sistema.

Al aprovechar los LLM externos para aplicaciones de atención médica, las prácticas estrictas de gobierno de datos son imprescindibles para salvaguardar la información confidencial del paciente [ 64 ]. A medida que los datos de texto o voz se envían a servicios LLM de terceros para su análisis, los contenidos contienen información de salud protegida (PHI) e información de identificación personal (PII) que debe permanecer confidencial.

Si bien los LLM en sí son modelos de análisis estáticos en lugar de sistemas de aprendizaje continuo, los proveedores que alojan estos modelos e impulsan las predicciones aún acceden física o computacionalmente a los datos enviados [ 65 , 66 ]. Independientemente de las garantías de los proveedores sobre los compromisos de privacidad, las obligaciones y las restricciones sobre la ingesta de contenido del cliente para el reentrenamiento del modelo, persisten riesgos residuales de fuga de datos o retención no intencionada. Para mitigar estos riesgos, los contratos legales integrales entre la organización de atención médica y el proveedor de LLM son fundamentales para garantizar la protección de la PHI/PII de acuerdo con las regulaciones sanitarias. Los acuerdos de socios comerciales, los acuerdos de uso de datos y los contratos maestros de proveedores de servicios permiten codificar formalmente los protocolos permitidos de procesamiento, almacenamiento, transmisión y eliminación de datos de LLM. Dichos contratos también establecen mecanismos de responsabilidad y ejecución en caso de incumplimiento atribuido al vendedor, incluidas cláusulas de notificación, indemnización y restitución. Controles de acceso estrictos, esquemas de cifrado, protocolos de auditoría de actividades y procedimientos de autorización deberían complementar estas protecciones contractuales. Si bien es posible que los LLM en sí mismos no acumulen interminablemente datos de atención médica como los sistemas de aprendizaje permanente, la debida diligencia en torno al destino a largo plazo de los datos enviados a los servicios de predicción de LLM sigue siendo muy recomendable para los equipos legales y de cumplimiento reacios al riesgo [ 14 ]. Establecer una gobernanza de datos sólida para la integración clínica emergente de LLM puede evitar una exposición regulatoria, ética y reputacional problemática [ 64 ].

Si bien está fuera del alcance de este artículo discutirlo en detalle, la organización también tendrá la responsabilidad de garantizar que el sistema de IA cumpla con las regulaciones de atención médica y las leyes de privacidad pertinentes [ 55 ], como la Ley de Responsabilidad y Portabilidad de Seguros Médicos (HIPAA) en los EE. UU. o Reglamento General de Protección de Datos (GDPR) en la Unión Europea.

Cuarto componente: gobernanza

Si bien la IA generativa tiene varias aplicaciones potenciales en la medicina clínica, también existen varios desafíos asociados con su implementación. Algunos de los desafíos incluyen los siguientes:

- ▪ Disponibilidad de datos : la IA generativa requiere grandes cantidades de datos para entrenar modelos de manera efectiva [ 8 ]. Sin embargo, en la medicina clínica, los datos suelen ser limitados debido a preocupaciones y regulaciones de privacidad. Esto puede dificultar el entrenamiento eficaz de modelos.

- ▪ Sesgo en los datos de entrenamiento : los modelos de IA generativa requieren grandes cantidades de datos de entrenamiento para aprender patrones y generar nuevos datos. Si los datos de entrenamiento están sesgados, el modelo de IA generativa también lo estará [ 13 ]. Por ejemplo, si los datos de entrenamiento están sesgados hacia un grupo demográfico particular, el modelo de IA generativa puede producir resultados sesgados para ese grupo.

- ▪ Transparencia : si bien los LLM poderosos como ChatGPT demuestran una impresionante capacidad de conversación, el origen opaco de sus corpus de capacitación masivos ha atraído con razón el escrutinio [ 64 , 65 ]. A falta de transparencia en torno al origen, el estado de los derechos de autor y las políticas de consentimiento de los datos subyacentes, persisten puntos ciegos legales y éticos. Para los LLM que se ofrecen comercialmente, es comprensible que los detalles de los procesos de capacitación sigan siendo propiedad intelectual exclusiva. Sin embargo, el uso de páginas web extraídas, debates privados o contenido protegido por derechos de autor sin permiso durante el desarrollo del modelo aún puede generar responsabilidad. Demandas recientes que alegan scraping no autorizado por parte de proveedores de LLM ejemplifican la creciente reacción.

- ▪ Interpretabilidad del modelo : los modelos de IA generativa pueden ser complejos y difíciles de interpretar, lo que dificulta que los médicos comprendan cómo el modelo llegó a sus conclusiones [ 13 , 67 ]. Esto puede hacer que sea difícil confiar en los resultados del modelo e incorporarlos en la toma de decisiones clínicas.

- ▪ Generación inexacta : si bien los LLM demuestran una fluidez y versatilidad impresionantes en aplicaciones conversacionales, su confiabilidad se desmorona cuando se aplica a dominios de alto riesgo como la atención médica [ 14 , 55 ]. Sin la base contextual en el conocimiento fáctico y la capacidad de razonamiento necesarios para la toma de decisiones médicas, los LLM plantean riesgos sustanciales para la seguridad del paciente si los médicos confían demasiado en ellos [ 14 ]. Los errores de alucinación representan un modo de falla demostrado, donde los LLM generan con confianza respuestas que suenan plausibles pero completamente inventadas y que se encuentran fuera de sus distribuciones de entrenamiento. Para las evaluaciones de pacientes, planes de tratamiento u otras funciones de apoyo clínico, estas falsedades creativas podrían fácilmente culminar en daño al paciente si no se validan rigurosamente [ 64 ]. Además, los LLM a menudo ignoran las dependencias matizadas en el razonamiento de varios pasos que subyacen a los juicios médicos sólidos. Sus capacidades se centran en asociaciones estadísticas más que en implicaciones causales [ 68 ]. Como tales, con frecuencia simplifican demasiado las complejas cadenas de decisiones que requieren experiencia en el campo y que los médicos deben sopesar. Aceptar ciegamente y sin escepticismo una sugerencia diagnóstica o terapéutica generada por un LLM puede propagar errores.

- ▪ Cuestiones regulatorias y éticas : el uso de IA generativa en la medicina clínica plantea varias cuestiones regulatorias y éticas [ 14 ], incluida la privacidad del paciente, la propiedad de los datos y la responsabilidad. Las políticas regulatorias, las consideraciones éticas y la opinión pública forman el contexto más amplio. Las leyes de privacidad de datos como GDPR en Europa o HIPAA en EE. UU. tienen implicaciones para la IA en la atención médica [ 65 ]. Es necesario abordar estos aspectos para garantizar que el uso de la IA generativa sea ético y legal.

- ▪ Validación : los modelos de IA generativa deben validarse para garantizar que sean precisos y confiables [ 62 ]. Esto requiere grandes conjuntos de datos y pruebas rigurosas, lo que puede llevar mucho tiempo y ser costoso.

Para minimizar los riesgos que surgen de la aplicación de la IA generativa en la atención sanitaria, es importante establecer un marco de gobernanza y evaluación basado en la ciencia de la implementación [ 64 ]. Marcos como el marco NASSS y el TAM deberían informar los pasos posteriores para promover el uso responsable y ético de la IA generativa [ 58 , 69 ]. Este enfoque de implementación basado en la ciencia incluye varios pasos para garantizar pruebas, monitoreo e iteración adecuados de la tecnología. El marco NASSS proporciona una lente útil para evaluar los complejos sistemas adaptativos en los que se integrarían las soluciones generativas de IA [ 58 ]. Este marco examina factores como la condición, la tecnología, la propuesta de valor, el sistema adoptante, la organización, el contexto más amplio y la interacción y adaptación mutua a lo largo del tiempo. El análisis de estos elementos puede revelar barreras y facilitadores para la adopción de IA generativa en las organizaciones de atención médica. Del mismo modo, el TAM se centra específicamente en los factores humanos y sociales que influyen en la adopción de la tecnología [ 59 ]. Al evaluar la utilidad percibida y la facilidad de uso percibida de los sistemas de IA generativa, TAM proporciona información sobre cómo tanto los pacientes como los proveedores pueden responder e interactuar con la tecnología. TAM fomenta la participación de las partes interesadas en el diseño del sistema para optimizar la aceptación del usuario.

Tanto NASSS como TAM exigen una estrategia bien pensada de gestión del cambio para introducir nuevas tecnologías como la IA generativa. Esto significa realizar pruebas iterativas y pilotaje de sistemas, desarrollar conjuntamente políticas de gobernanza con diversas voces, enfatizar la transparencia, proporcionar amplios recursos de capacitación para los usuarios, desarrollar protocolos para evaluar la calidad y la equidad de la IA, permitir la personalización de las herramientas por parte de los usuarios y evaluar continuamente el impacto para permitir la implementación adecuada. adaptación a lo largo del tiempo. Aprovechar estos modelos garantiza una integración responsable y ética guiada por las necesidades del usuario final. Los siguientes son los pasos correspondientes:

- ▪ Establecer o utilizar un comité de gobernanza : este comité debe estar compuesto por expertos en inteligencia artificial, atención médica, ética, derecho y defensa del paciente. La responsabilidad del comité es supervisar la creación e implementación de aplicaciones de IA generativa en la atención médica, asegurándose de que cumplan con los más altos estándares morales, legales y profesionales.

- ▪ Desarrollar políticas y directrices relevantes : crear políticas y directrices que aborden cuestiones como la protección y seguridad de los datos, el consentimiento informado, la apertura, la responsabilidad y la equidad en relación con el uso de la IA generativa en la atención sanitaria. Las directrices también deberían cubrir el posible abuso de la IA y establecer procesos precisos de presentación de informes y resolución.

- ▪ Implementar prácticas sólidas de gestión de datos : esto incluye garantizar la privacidad y seguridad de los datos, obtener el consentimiento informado para el uso de los datos y garantizar la calidad e integridad de los datos. También implica el uso de conjuntos de datos diversos y representativos para evitar sesgos en los resultados de la IA.

- ▪ Mitigar los datos generados inexactos : en general, si bien los LLM tienen fortalezas en ciertas aplicaciones limitadas, sus limitaciones para recordar los últimos hallazgos, fundamentar los consejos en conocimientos biomédicos y el pensamiento analítico deliberativo plantean riesgos en las funciones clínicas [ 14 ]. Mitigarlos requiere salvaguardias tanto tecnológicas como de procesos. Como mínimo, las pruebas meticulosas en conjuntos de datos masivos y validados, la cuantificación transparente de la incertidumbre, la colaboración multimodal entre humanos e IA y la supervisión constante de expertos resultan esenciales antes de contemplar la adopción de un LLM para funciones que impactan al paciente. Con una gestión cuidadosa, los LLM pueden ayudar a los médicos, pero no pueden reemplazarlos.

- ▪ Evaluación de riesgos : antes de la implementación, las organizaciones de atención médica deben realizar evaluaciones de riesgos estructuradas para inventariar y cuantificar los posibles daños a los pacientes derivados de la adopción de la IA generativa. Deben participar equipos multidisciplinarios que incluyan médicos, seguridad de TI, asuntos legales/de cumplimiento, gestión de riesgos e ingenieros de inteligencia artificial. Un examen amplio de los casos de uso, las dependencias de datos, los supuestos de rendimiento, las salvaguardias, la gobernanza y los escenarios de responsabilidad proporcionan la base. Los peligros identificados abarcan desde imprecisiones clínicas, como sugerencias de tratamientos inadecuados, hasta riesgos operativos, como resultados sesgados o diagnósticos detenidos por interrupciones técnicas. Otras consideraciones clave son el uso indebido malicioso, los defectos que se propagan como datos de entrenamiento y la violación de registros confidenciales que comprometen la privacidad o la confianza.

Para cada riesgo plausible, la evaluación calibra estimaciones de probabilidad y gravedad para variables como tipos de usuarios, clases de información y controles de mitigación. El monitoreo continuo de riesgos basado en indicadores líderes y auditorías de uso garantiza que la evaluación inicial se adapte a los inevitables cambios de modelo y aplicación a lo largo del tiempo. La elaboración de modelos probabilísticos periódicos utilizando metodologías de garantía de seguridad refuerza aún más la gobernanza responsable. En general, un enfoque ágil y cuantificado del riesgo prepara a las organizaciones para buscar de manera responsable los beneficios de la IA generativa y al mismo tiempo proteger a los pacientes.

- ▪ Garantizar la transparencia : Garantizar la transparencia de los modelos de IA generativa proporcionando documentación clara de los algoritmos subyacentes, las fuentes de datos y los procesos de toma de decisiones. Esto promueve la confianza y permite a los profesionales de la salud comprender e interpretar los resultados generados. Para las organizaciones sanitarias reacias al riesgo, asociarse con proveedores de LLM que rechazan una transparencia razonable de los datos genera preocupación. Si las predicciones del modelo se sustentan en datos inadecuados, ilegales o fraudulentos, la seguridad del paciente y la reputación de la organización pueden verse afectadas [ 13 , 68 ]. Además, podrían surgir litigios por incumplimiento normativo, violaciones de la privacidad o tergiversaciones basadas en fuentes de datos LLM cuestionables [ 14 ]. No obstante, para muchas funciones clínicas, los LLM desarrollados externamente pueden ayudar suficientemente a los médicos sin una transparencia total de los corpus subyacentes. Las aplicaciones conversacionales simples probablemente plantean poca preocupación. Sin embargo, para obtener recomendaciones de atención más impactantes o resultados específicos del paciente, los médicos deben validar las sugerencias en consecuencia en lugar de presumir la integridad [ 64 ]. En general, la naturaleza inaccesible de los datos comerciales de formación de LLM es un obstáculo, pero no un factor decisivo si se controla cuidadosamente cómo se utilizan las predicciones. Aún así, la transparencia sigue siendo una cuestión de promoción constante que los proveedores de atención médica deberían defender [ 64 ].

- ▪ Cumplimiento regulatorio : Garantizar el cumplimiento de los marcos regulatorios relevantes, como las leyes de protección de datos y las regulaciones de dispositivos médicos. Colaborar con las autoridades reguladoras para establecer directrices específicas para la IA generativa en la atención sanitaria. Establecer procedimientos para el seguimiento y la evaluación continuos de los modelos es crucial, además de las medidas para permitir la gobernanza de los modelos de IA generativa [ 67 , 70 ]. Esto implica recopilar opiniones de pacientes y expertos en atención médica, así como un seguimiento regular del desempeño, la seguridad y las consideraciones éticas. Las organizaciones de atención médica pueden reducir los riesgos y garantizar el uso apropiado y ético de la IA generativa en la atención médica si cumplen con cada paso de este marco (Fig. 2 ). El marco de gobernanza aprovecha las ventajas potenciales de la tecnología de IA generativa al tiempo que promueve la apertura, la responsabilidad y la seguridad del paciente.

Conclusión

Los sistemas sanitarios de todo el mundo se enfrentan a crisis de asequibilidad, acceso y calidad inconsistente que ahora ponen en peligro la salud pública [ 71 ]. La IA generativa presenta soluciones para comenzar a rectificar estas fallas sistémicas mediante una implementación responsable guiada por las mejores prácticas científicas.

Los marcos validados como el modelo TAM y NASSS proporcionan hojas de ruta viables para la gestión del cambio, la alineación de las partes interesadas y la optimización del impacto [ 58 , 59 ]. Permiten anticipar las barreras de adopción relacionadas con el valor percibido, la usabilidad, los riesgos y más, al tiempo que delinean intervenciones para impulsar la aceptación. Con una planificación meticulosa basada en evidencia, la IA generativa puede transformar la productividad, el conocimiento y la mejora de la atención. Casos de uso como la automatización del flujo de trabajo y la documentación, el análisis predictivo personalizado y los chatbots para la educación del paciente confirman un gran potencial [ 26 , 41 , 45 ], siempre que la tecnología apoye en lugar de suplantar la experiencia humana. Las integraciones estructuradas que enfatizan el control médico salvaguardan la calidad y al mismo tiempo desbloquean la eficiencia. Una traducción bien pensada es esencial, pero la ciencia de la implementación proporciona una guía comprobada.

El tiempo del debate ha pasado. Los pacientes de todo el mundo se beneficiarán y los líderes responsables deben actuar con urgencia. Los proyectos piloto estratégicos, el escalamiento iterativo y la gobernanza que enfatizan la ética junto con la innovación lograrán avances largamente esperados. La IA generativa no puede reparar por sí sola sistemas defectuosos, pero una adopción cuidadosamente facilitada puede catalizar reformas y al mismo tiempo cumplir con las obligaciones humanitarias de la atención médica. El enfoque, no sólo la tecnología, define el éxito. Guiada por la sabiduría y la compasión, la IA generativa puede ayudar a restaurar los ideales de atención médica de los que hoy tanto carecen: calidad, asequibilidad y atención humana para todos.